Заборонити розробку супер інтелекту – бо він може перевершити людей у когнітивних завданнях, вже за декілька років. З такою петицією звернулися понад 800 впливових людей світу до розробників ШІ. Утім, компанії як Meta активно інвестують мільярди в розвиток ШІ й вже готують суперкомп’ютерні кластери до 2026 року.

То мавпа, що літає на парасолі, то кіт викрадач риби у супермаркеті, а то Майкл Джексон у ресторані швидкого харчування – такі відео масово вірусяться в мережі. Здається, не лишилось жодної людини, яка б не бачила бодай один ролик, згенерований ШІ. Причому, багато хто сприймає такі речі "за чисту монету".

Нині є чимало сайтів на яких можна створити подібні відео. Аби реалізувати ідею, треба максимально точно поставити задачу. Наприклад – перетворити філіжанку на птаха – далі програма все зробить сама. Бажаючих спробувати – дуже багато. Відповідно – і результатів їх творчих експериментів у мережах стільки, що в людей голова обертом йде. І вони не розуміють, як визначити справжнє відео чи ні.

Якщо ви маєте сумнів у реальності відео, його можна перевірити за допомогою додатку Google images. Треба завантажити в нього кадр. І отримати відповідь щодо джерела. Є і певні візуальні підказки.

"Якщо говорити про відео з зображенням людини, що дуже цікаво, то тінь буде завжди неприродно падати, людина стоїть прямо, а тінь лівіше й абсолютно маленька. Десь бачила відео, що стоїть людина, а в неї тінь собаки", – сказала незалежна консультантка з онлайн безпеки Анастасія Апетик.

Але з часом штучний інтелект розвивається. Його відео стають більш якісними. І це створює справжні ризики. Бо не всі використовують ці можливості винятково для жартів. Вже відомий випадок, коли українка вкрала понад 4 мільйони гривень, обманюючи онлайн-банки. Жінка накладала обличчя реальних людей на штучне відео для верифікації. І система сприймала його як справжнє.

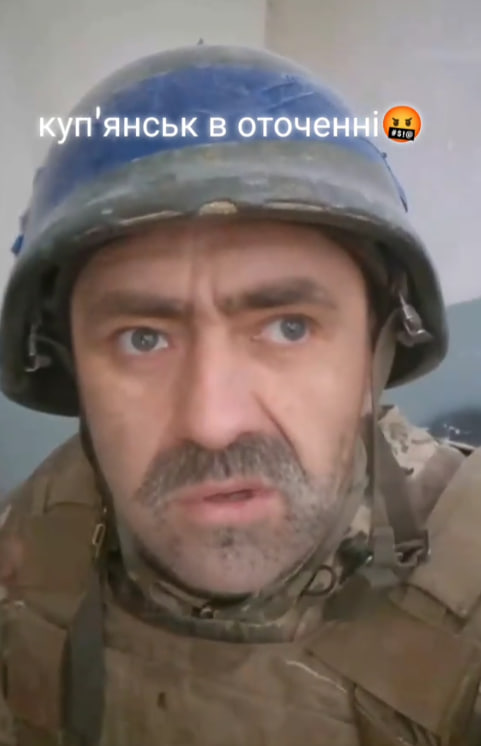

Росіяни використовують цю технологію у війні проти України – вигаданий сюжет про те, як українські військові здаються в окупованому Куп’янську. Однак, підробку видно відразу – погляд пустий, голос штучний. Ще один фейк згенерований ШІ останніми днями поширили окупанти, мовляв, українські військові здаються у полон у Покровську. Це все одна з частин інформаційної кампанії росії.

"Те що вони використовують зараз поодиноку в майбутньому буде користуватися великими об'ємами великими масами людей, тобто росія пропише певні закони. Будуть створені певні війська. Так само швидко розвивається штучний інтелект так само швидко розвивається протидія йому", – вважає керівник департаменту медіаграмотності ЦПД РНБО Іван Сличко.

Тож, коли бачите відео, не поспішайте вірити – спершу уважно перегляньте ролик ще раз: чи немає там розмитого лого додатка, неприродної поведінки людей, дивні тіні, чи надто нереалістичні події. А також перевірте першоджерело. Це можна зробити в Google Images. І звісно завжди не буде зайвим порадитись зі знайомими та близькими.